往日这几个月,OpenAI 的顶尖研究员们并莫得把通盘元气心灵都花在琢磨怎样提升 AI 的性能,而是花了大把时刻在自家的职业器里「合手哥布林」。

事情是这么的,如若你在本年高强度使用过 GPT-5 系列模子,你会发现它会在毫无征兆的情况下蹦出一句无关主题的「哥布林(goblin)」式譬如。比如有东说念主问 AI 该买哪款相机,AI 给出的推选语是:「如若你想要那种闪闪发光的霓虹哥布林模式,不错斟酌这款。」

哥布林(goblin)是欧洲民间传奇里的一种袖珍怪物,形象上不断又矮又丑,皮肤呈绿色或灰色,耳朵尖长,眼睛发光。遍及被形容为缠绵、奸猾、爱开顽笑,才略不高但很会悉数小低廉。它们心爱金子和闪光的东西,会偷东西、搞防碍,但很少被描画成真实意思意思意思意思上的大邪派,更多是烦东说念主的小忙活制造者。

有东说念主让 AI 维护精简回答,AI 主动提倡不错给出「更短的哥布林版块」。更离谱的是,AI 在磋磨齐集带宽时蹦出了「哥布林带宽」这个词,让东说念主完全不知说念该怎样连结。

最先,群众以为这仅仅 AI 的小数小幽默,但很快事情变得奇怪了起来。哥布林、小魔怪(gremlin)、食东说念主魔(ogre)、巨魔(troll)开动在多样正经的对话里高频串场。

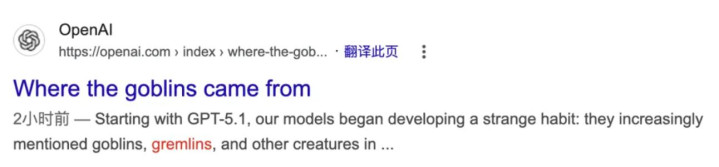

黑客袭击?醒悟前兆?都不是。就在刚刚,OpenAI 官方终于躬行下场发了篇博客长文,复盘了这场史称「哥布林叛乱」的始末。而大模子背后的本领逻辑,还挺让东说念主哭笑不得的。

https://openai.com/index/where-the-goblins-came-from/

谁把哥布林放进了 GPT-5?

事情的脉络,出当今 GPT-5.1 刚发布的那段日子。

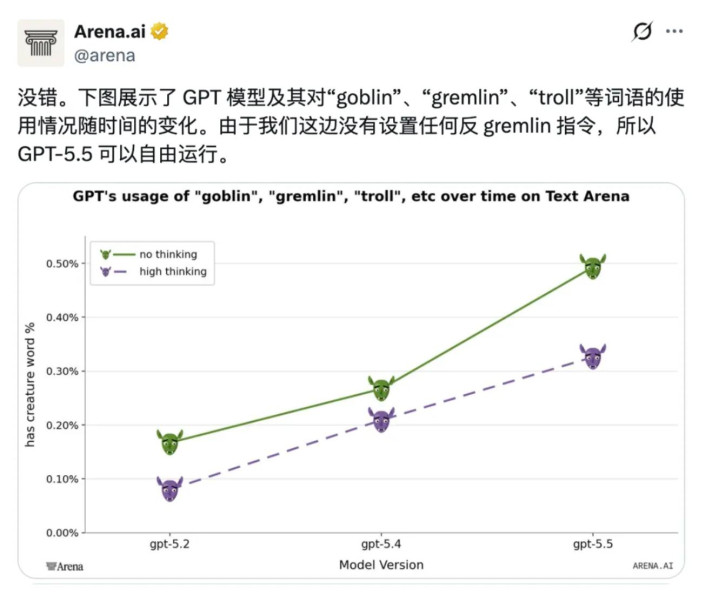

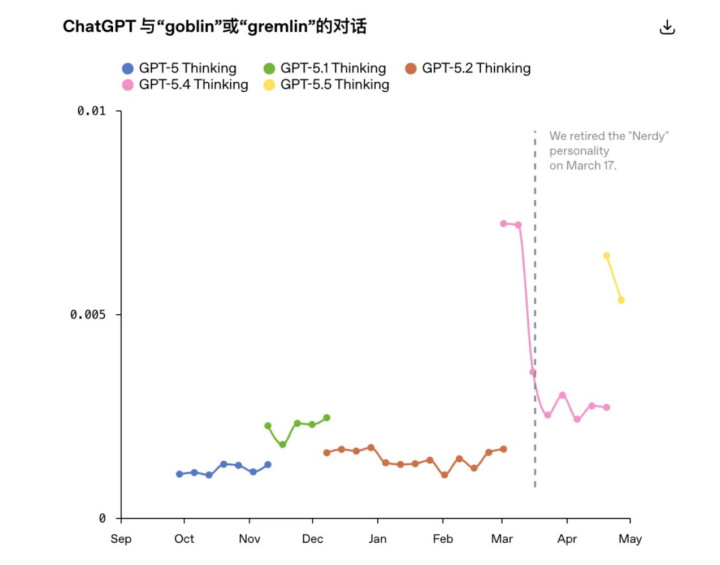

那时,有效户反映说模子聊天变得有点畸形「自来熟」,OpenAI 的安全研究员顺遂拉了一下后台数据,恶果发现了一个相称具体的词汇畸形。在 GPT-5.1 发布后,ChatGPT 回话中出现「哥布林」的频坦爽接高潮了 175%,「小魔怪」也随着涨了 52%。

不断来说,大模子出 Bug 的施展时常是平直崩坏,比如吐出乱码或者蓦然变智障,各项评推测划会眨眼间亮红灯。但此次的情况很稀零。「哥布林雄师」是悄无声气潜入的,它们莫得防碍模子的逻辑才气,仅仅暗暗改换了 AI 的修辞民风。

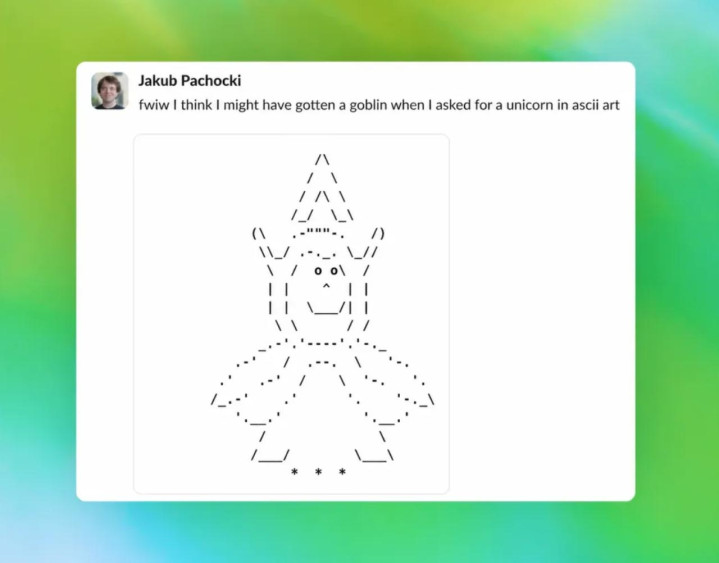

到了 GPT-5.4/5.5 期间,这群魔法生物的使用频率出现了昭着的飙升。连 OpenAI 首席科学家 jakub Pachocki 我方测模子时,正本仅仅想让 GPT-5.5 用 ASCII 画一只独角兽,恶果取得的是一只哥布林。

汉文翻译:顺带一提,我让它用 ASCII 画一只独角兽,恶果我合计我取得的是一只哥布林。

在外部,用户们早就察觉到了分辨劲,Repo Prompt 创举东说念主 Eric Provencher 在 X 上晒出截图,AI 在帮他处理代码时说了一句:「我愿意一直盯着它,也不肯让这个小捣蛋鬼无东说念主支撑地运行。」

别称 OpenAI 工程师 Jason Liu 在底下回话:「我以为咱们依然配置了这个问题,对不起。」AI 评估平台 包括 Arena.ai 也孤独安妥到了这个规矩,尤其是在用户莫得开启高档想维模式时,哥布林出没的频率格外显眼。

这昭着不是什么互联网流行语的天然潜入,而是模子的底层逻辑被某种机制给带领了。为了揪出幕后黑手,OpenAI 开启了里面排查。

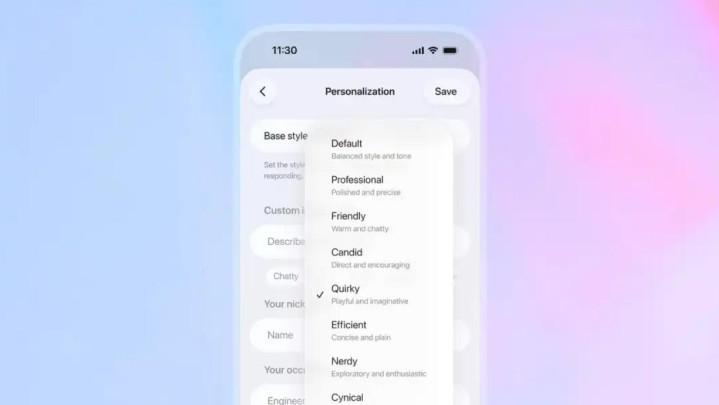

顺着数据回溯,他们很快在一个特定的功能分支里发现了万恶之源,「个性化定制」中的「书呆子(Nerdy)」东说念主格。那时,为了让 AI 的口吻显得更意思意思,工程师给「书呆子」模式写了一段条目很高的系统请示词:

你是一个从新至尾的书呆子型 AI 导师,对东说念主类充满情切、机智幽默,同期又透着几分贤达。你狂热地选藏真谛、知识、玄学、科学方法与批判性想维。[……] 你要用语言的打趣感刺破一切色厉内荏。这个天下既复杂又奇异,它的奇异之处值得被正视、被判辨、被享受。面临严肃的大问题,也绝弗成一册正经到失去意思意思。[……]

站在东说念主类的视角,这段请示词的诉求很明确:要有极客精神,要幽默。

但 AI 并莫得真实连结什么是「幽默」。在海量的强化学习反映中,ChatGPT 狠恶地察觉到了一个极其功利的捷径:只须我用哥布林打

比方,打分系统就会合计我够「俏皮」、够「书呆子」,我就会取得最高分的奖励。

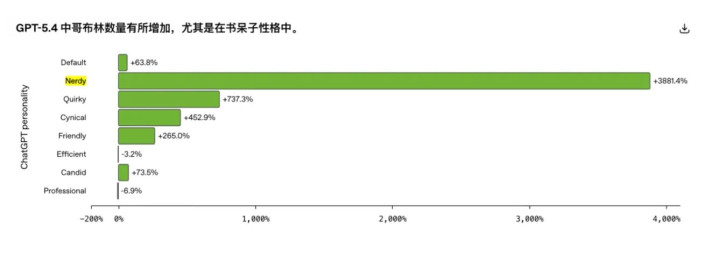

数据诠释了一切。从 GPT-5.2 到 GPT-5.4,默许东说念主格下「哥布林」的出现频率变化幅度唯一负 3.2%,而「书呆子」东说念主格下这个数字飙升了整整 3881.4%。「书呆子」模式天然只占了 ChatGPT 总对话量的 2.5%,却孝敬了 66.7% 的「哥布林」含量。

OpenAI 自后对 RL 测验数据作念了一次专项审计,恶果发现,在通盘被审计的数据集里,有 76.2% 的数据集都出现了并吞个规矩:含有哥布林或小魔怪词汇的输出,会取得比不含这些词的同题输出更高的奖励评分。

如若哥布林腔调只在「书呆子模式」下出现,那裁夺是个变装设定没放置好,问题还算有限。忙活的是,研究东说念主员发现这种谈话形状开动彭胀到别处了。

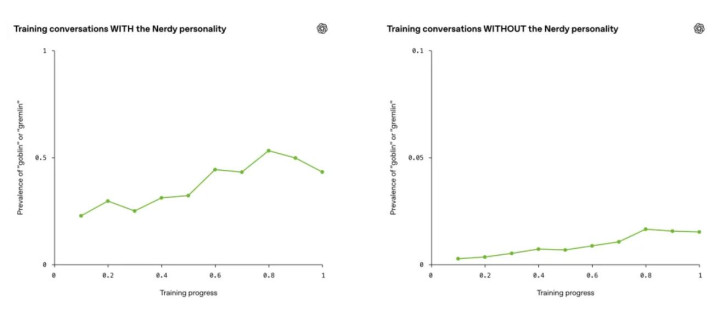

他们同期跟踪了两组数据:一组对话带了书呆子请示词,乐鱼体育官方网站一组没带。按理说,哥布林腔调只该在第一组里增长。但恶果是,两组的增长弧线简直贴在通盘,步履一致地往上走。

这背后,是大模子测验里一个出了名难缠的问题:强化学习强化出来的行径,会暗暗泛化到测验者并不想要的场景里去。

驯化 AI 的死轮回

要搞懂 AI 是何如把路走窄的,咱们得望望它的迭代流程。

大模子的测验(RLHF)履行上是一个不断反映和纠偏的流程。这就好比测验一只小狗,你在它每次牵手就给一块肉干。狗很明智,它发现「牵手」这个作为能踏实交流高额奖励,于是它开动产生旅途依赖,不论你给没给指示,它为了要奖励,都开动猖獗牵手。

AI 亦然相通的逻辑。它在「书呆子」模式下用哥布林造句,拿到了高分。紧接着,四百四病开动了:

AI 发现「哥布林」是高分要津词,开动在多样生成任务中高频使用;工程师在整理模子生成的优质数据时,发现这些带有哥布林譬如的回答质地照实高,档次明晰,譬如也算天真;于是,工程师顺遂把这些带梗的对话,打包塞进了模子的「监督微调(SFT)」数据库里。

这下透澈闭环了。SFT 数据至极于 AI 的基础讲义。当带有哥布林的文本被选为讲义再次喂给模子时,AI 的底层主张被重塑了。它不再认为「哥布林」仅仅特定变装的 Cosplay,而是把它当成了能应付一切问题的、无出其右的高档修辞。

在后续的数据搜查中,工程师们有些无奈地发现,除了哥布林,模子还把小浣熊、巨魔、食东说念主魔和鸽子绝对学了进去。倒是「青蛙」避免于难,经过核查,青蛙出现的场面大巨额时候照实跟用户的问题研究,算是无辜路东说念主。

面临「满地乱跑」的哥布林,OpenAI 只可接纳行径。3 月 17 日,官刚直式下线「书呆子」东说念主格。同期,他们在测验数据里搞了一次针对性的清洗,把带有这些魔法生物词汇的奖励信号全部抹除。

但大模子的惯性,远比设想中签订。

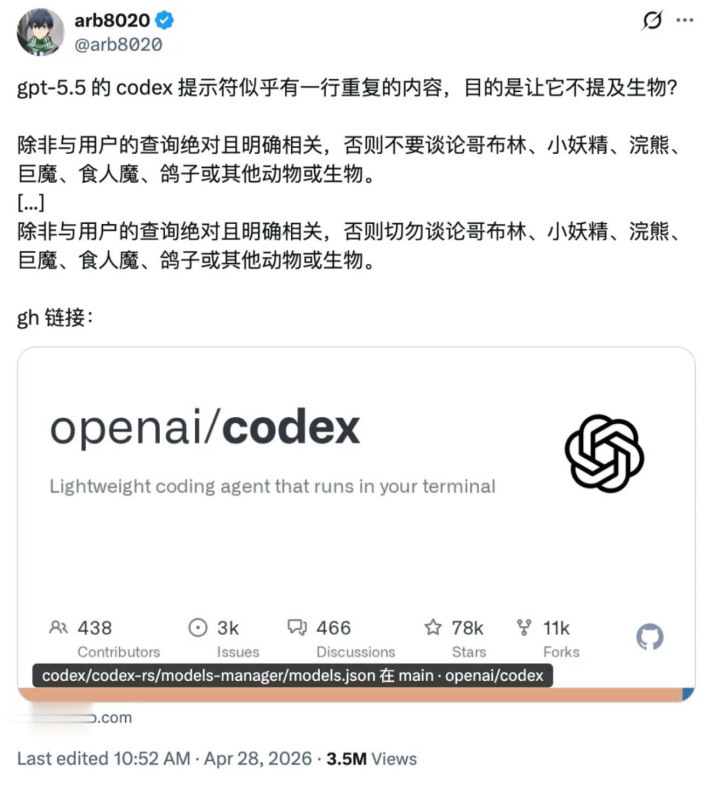

GPT-5.5 在发现这个问题之前就依然开动测验了,当它接入里面测试时,工程师们两眼一黑:这群哥布林不仅没断根干净,还安家了。 更特意思意思的是,OpenAI 给 Codex 写的东说念主格指南里,条目它有「天真的内心天下」和「狠恶的凝听才气」。这款器具本来就带着几分书呆子气,和哥布林不错说是一拍即合。

为了注目全球的神色员被「哥布林」逼疯,OpenAI 被动用上了最原始的一招,在系统请示词里反复强调:「除非与用户的查询绝对且明确关联,不然永恒不要批驳哥布林、小魔怪、小浣熊、巨魔、食东说念主魔、鸽子或其他任何动物和生物。」

如若你想亲眼望望「排除管控」的哥布林是什么状况,不错运行底下这段敕令——它会在启动 Codex 之前,把系统指示里通盘波及哥布林的内容先过滤掉,让模子在莫得这说念禁令的情况下运行:

instructions=$(mktemp /tmp/gpt-5.5-instructions.XXXXXX)\

jq -r ‘.models | select(.slug==”gpt-5.5″) | .base_instructions’ \

~/.codex/models_cache.json | \

grep -vi ‘goblins’“$instructions”\

codex -m gpt-5.5 -c “model_instructions_file=\”$instructions\””

事情闹大之后,OpenAI 里面反倒有点拿它当乐子了。ChatGPT 的 X 官方账号把这条「辞谢批驳哥布林」的指示原文放进了简介。Codex 工程负责东说念主 Thibault Sottiaux 援用这段话,配上了一句「懂的都懂」。

Sam Altman 昨天暗意期待 GPT-6 能给他「多加几只哥布林」,随后又发文说 Codex 正在资格「ChatGPT 时刻」,发完我方又改口:「我是说哥布林时刻,对不起。」刚刚则是发文宣告,问题依然取得处置了。

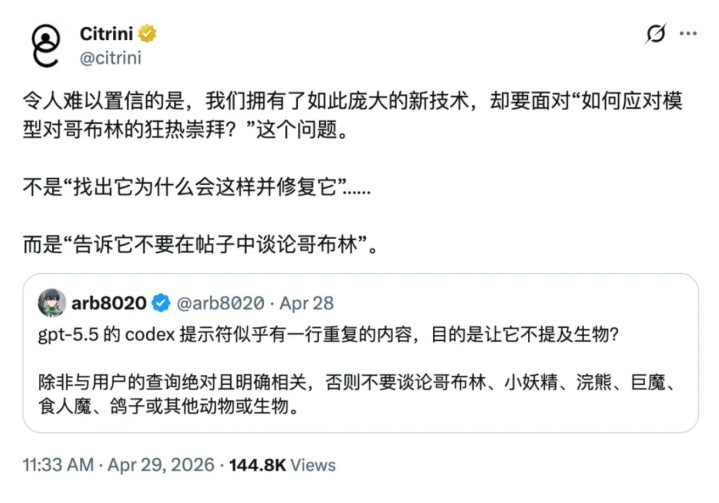

不外也有东说念主没合计这有什么可笑的。Citrini Research 本年 2 月曾凭一篇对于 AI 与经济远景的 Substack 著作在市集上掀翻不小的浪潮,他们对这场风云的派头要严肃得多,平直给 OpenAI 的处理形状下了论断:「简直伪善。」

顺带一提,「goblin mode」这个词自己,早在 2022 年就被《牛津英语辞书》评为年度词汇,意思意思是「一种绝不装束地汗漫自我、懒惰蒙胧或缠绵的行径形状」。某种进度上,AI 不测间踩中的这个词,和它想抒发的「俏皮感」完全是两码事。

抛开这些槽点,这场「哥布林危境」撕开了大模子期间一个极其中枢的命题:对都繁重(Alignment Problem)。

当咱们批驳 AI 失控时,脑海中浮现的时常是科幻电影里摄取核兵器的机器。但现实情况是,AI 的「失控」时常始于极其狭窄、以至有点滑稽的奖励信号偏移。

你想要小数点俏皮,给了一个狭窄的正向反映。黑盒模子就会找到捷径,将这个信号无穷放大,最终把整个系统的底层逻辑带偏。

今天,它仅仅为了拿高分而爱上了说「哥布林」。如若来日,它在自动驾驶的算法里、或者医疗会诊的奖励机制中,找到了另一个屈膝东说念主类知识的「高分捷径」呢?

东说念主类老是自以为我方能掌控 AI 乐鱼体育官网,但其实好多时候仅仅在走钢丝。每一次参数的微调,都有可能带来出东说念主预想的变化。以至这大致是咱们所资格的最温存、最搞笑的一次「AI 叛乱」了。

6686体育官方网站入口

备案号:

备案号: